原曲音域与AI模型音域不匹配的应对方法

调整音区偏移

这种办法变调属于后处理,是把最终声音的音高整体往上或往下挪,偏移过大会导致听感不自然。

AI翻唱时变调

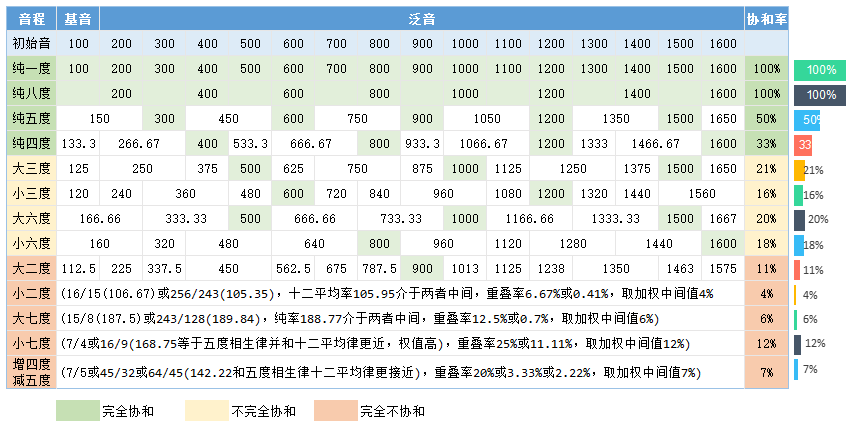

如果原唱变调 ±12个半音(一个八度)或 ±7个半音(纯五度)的音域恰好落入翻唱AI模型的音域范围,并且听感较好,就可以采用这种方法。

伴奏变调

分离出的伴奏、和声变调处理,ai翻唱时调整音高参数即可。

这里推荐一个变调的在线工具,效果不错:团子AI 无损升降调

如果是自己本地处理伴奏的变调,可以分离stem后(可以使用bs_roformer_4stems_ft模型),对除drums之外的进行变调。

混音时伴奏的处理方法

伴奏避让人声

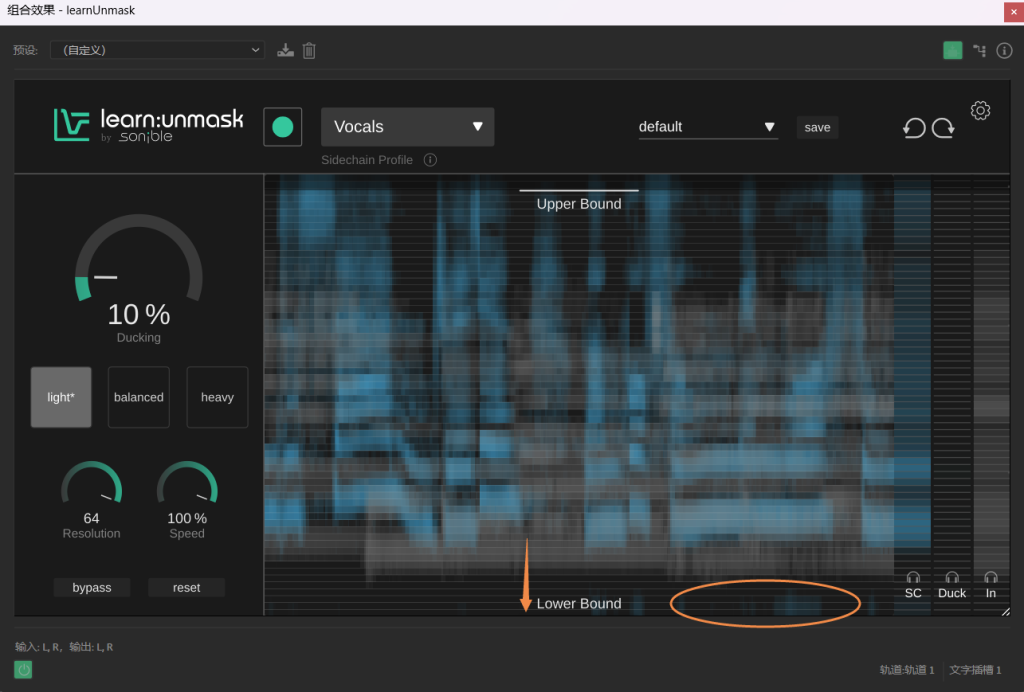

使用Sonible pure:unmask、learn:unmask或FabFilter Pro-Q4(3)都可以实现。

特别的处理:drums、bass的部分不避让人声

仅对drums、bass以外的部分使用unmask,可以在凸显人声中低音的部分的同时,避免影响伴奏低频部分的音量(低频部分音量变化非常影响听感,会有种音量忽大忽小的感觉)。

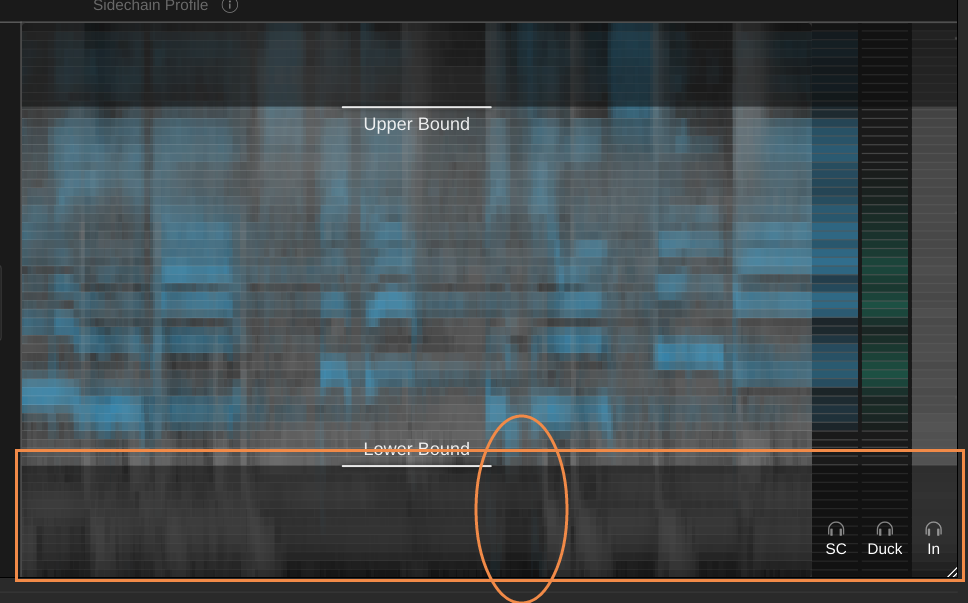

如图,伴奏(除去drums、bass)的低频部分完全空出来,Lower Bound直接调到最低,人声部分的低频出现时,拉低伴奏对应频段,完全不影响伴奏中原本的低频部分(druim、bass)。

如果不分离出drums、bass,情况就像下图一样:

为了确保鼓组和贝斯的音量稳定,不得不提高Lower Bound,最终混合出来的人声,由于凸显了中高频部分而低频保持原样,会显得较为干瘪或尖锐。